基于 14 年的 MFRL 论文,利用相邻 state-action 的空间相关性来加速学习,用 gaussian processes 建模 env dynamics(model-based)/ Q function(model-free),得到了两种跟 14 年 MFRL 很相似的算法 。

全文快读

- 题目:Multi-fidelity Reinforcement Learning With Gaussian Processes: Model-Based and Model-Free Algorithms

- 链接:https://ieeexplore.ieee.org/abstract/document/9069479

- IEEE Robotics & Automation Magazine 是 robotics 顶刊。

- main idea:

- 基于 14 年的最初的那篇 MFRL 论文(本站博客),

- 利用相邻 state-action 的空间相关性来加速学习,用 gaussian processes 建模 env dynamics(model-based)/ Q function(model-free),从而得到 model-based model-free 两种 MFRL 算法。

- 算法结构跟 14 年的 MFRL 基本一致。

- 全文没有数学证明。

1 intro

- 利用相邻 state-action 的空间相关性来加速学习:通过 Gaussian Process(GP)作为函数逼近器。

- 主要贡献:两个算法。

- model-based MFRL 算法 GP-VI-MFRL,估计转换函数,然后使用 value iteration 计算最优策略。

- model-free MFRL 算法 GPQ-MFRL,直接估计最优 Q 值以及随后的最优策略。

3 背景

4 method

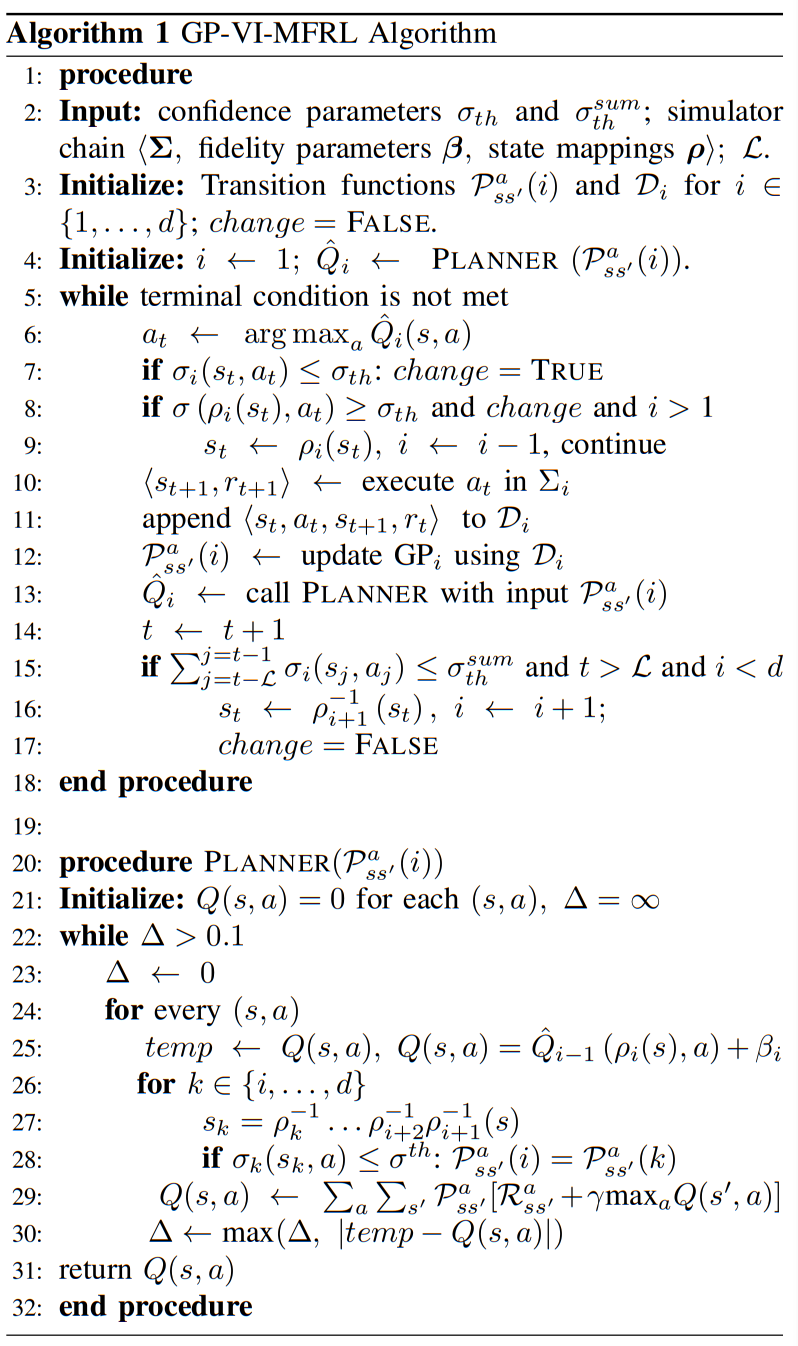

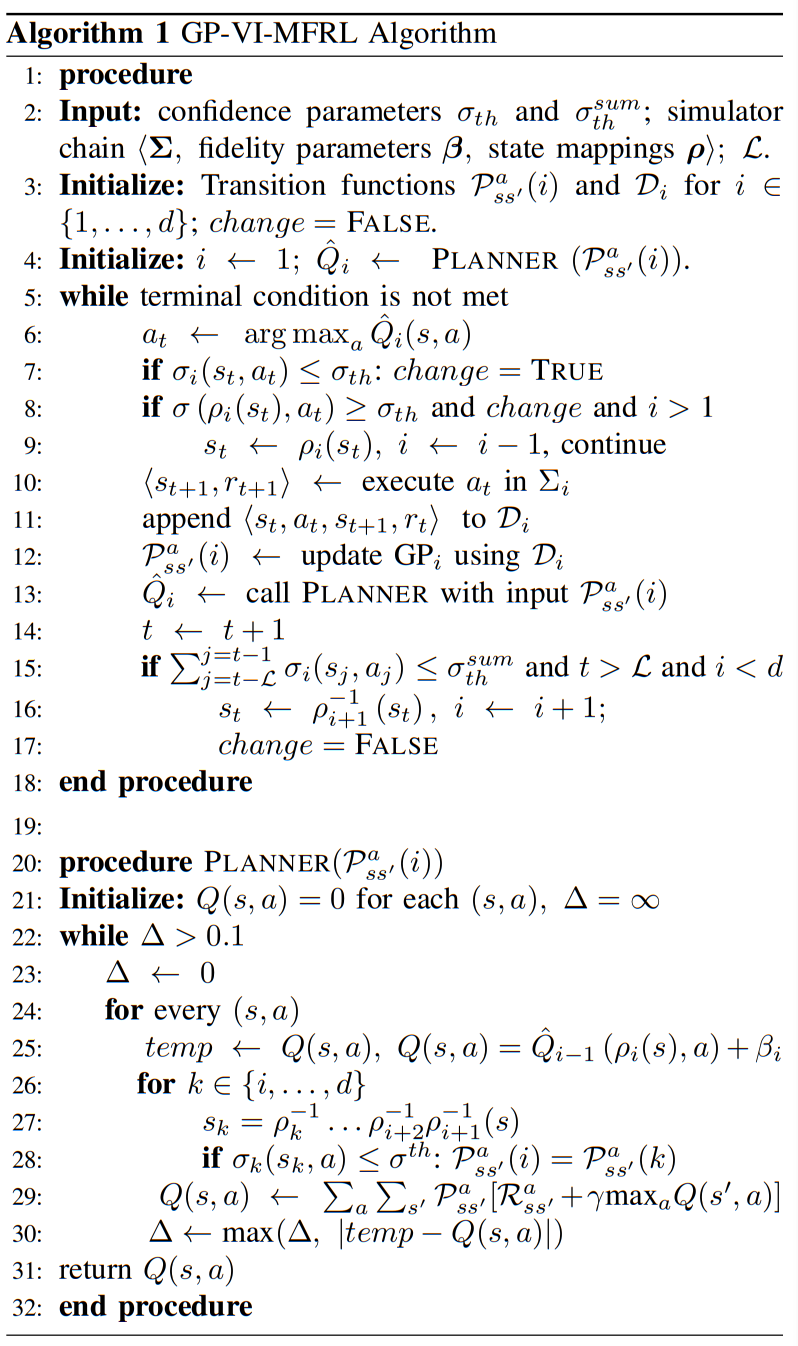

4.1 model-based 算法:GP-VI-MFRL

- 结构:包括 1 model learner、2 planner。

- model learner 使用 GP regression 学 env transition: s_{t+1} = f(s_t,a_t),使用高斯分布的形式。

- 使用 value iteration 作为 planner,用学到的 env transition 计算出最优策略。

- 算法:

- 在执行一个 action 前,agent 检查(第 8 行)它是否对当前 state-action pair 在前一个模拟器 Σi-1 中的 transition function 有足够准确的估计(方差小于 σ_th)。

- 如果不是,并且如果当前环境中的 transition model 发生了变化,它就会切换到 Σi-1,并在 Σi-1 中执行 action 。

- 跟踪当前模拟器中,最近访问的 L 个 state-action 对的方差。若方差和低于阈值 σ_th^sum(第 15 行),表明 agent 对当前模拟器很有信心,可以推进到下一个模拟器。

- 在最初的工作中 [2],agent 遇到一定数量的已知 state-action 对后,就会切换到更高保真度的模拟器。

- (第 7 行)如果一个 state-action pair 的后验方差下降到阈值 σ_th 以下(即 agent 对该 transition 有足够准确的估计),当前环境的模型就会改变,即 change = TRUE。

- 第 10 - 13 行描述了算法的主体, agent 执行贪婪地选择的 action(第 6 行),并在 Di 中记录观察到的 transition (第 11 行)。 transition function 的 GP 模型在每一步之后被更新(第 12 行)。每次更新 transition function 后,都会计算新的 Q 值估计(第 13 行)。

- 对每个模拟器,使用一个单独的 GP 来估计它的 transition function 。

- 终止条件(第 5 行):步数限制、价值函数的变化、最大的 env 切换次数…

- planner 利用上级(第 26 - 28 行)和下级模拟器(第 25 行)的转换知识,鼓励当前模拟器的探索。

- 对于每一个 state-action pair (s,a),planner 寻找最大保真度的模拟器(第 26 行遍历所有模拟器),这个模拟器对 (s,a) 的 transition 有一个已知的估计(第 28 行),使用这个估计在当前模拟器中进行规划(第 28 行)。

- 如果方差低于一个阈值,那么一个估计值就被称为“已知”。

- 如果没有这样的模拟器,那么它就使用在前一个模拟器中学到的 Q 值,再加上一个保真度参数 β(第 25 行),这个参数是连续的模拟器中最佳 Q 值之间的最大可能差异。

- 必须进行状态空间离散化,以规划 action 。然而,学到的 transition function 是连续的。

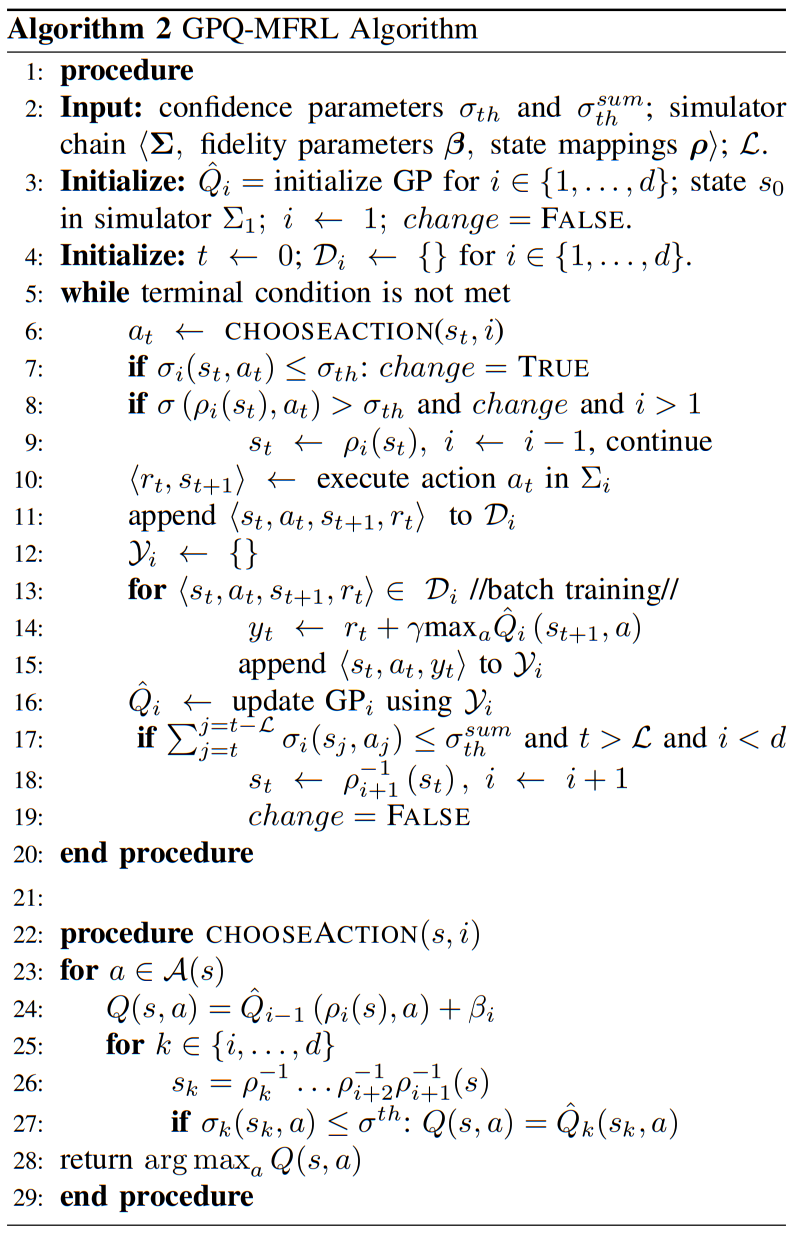

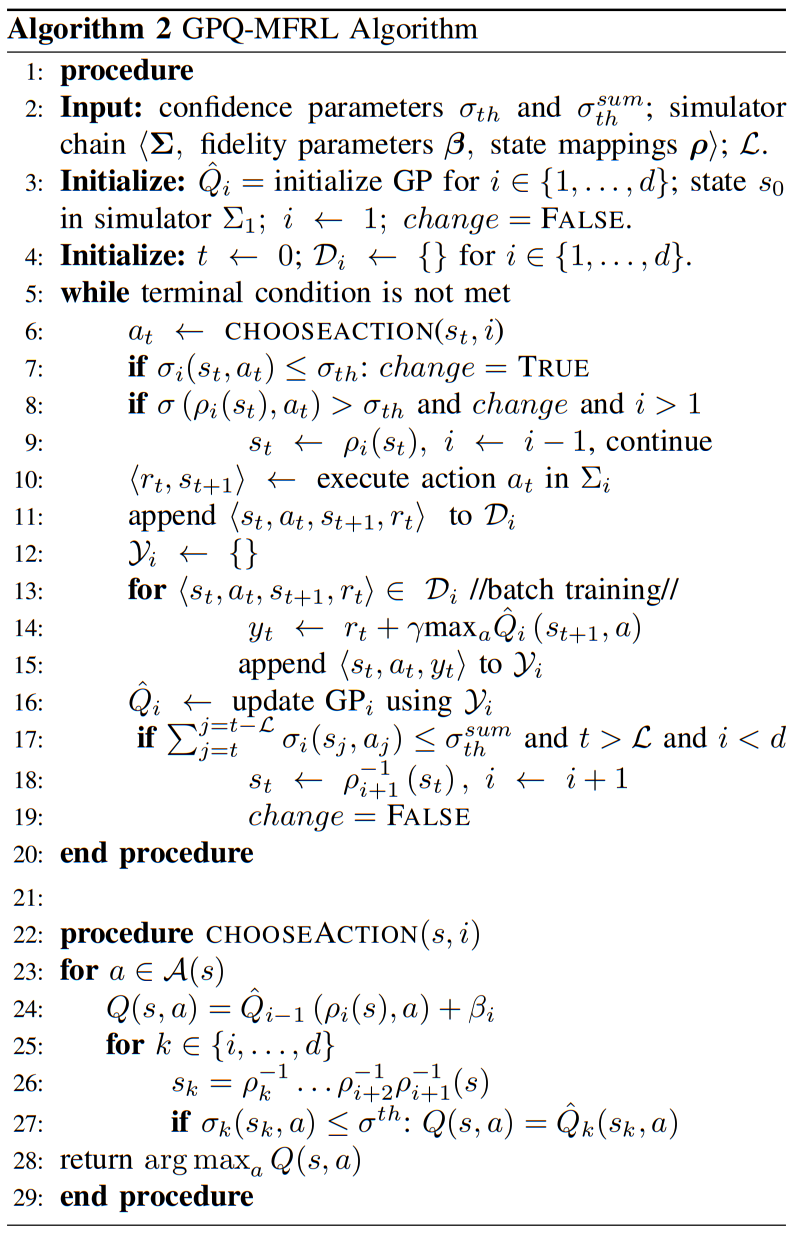

4.2 model-free 算法:GPQ-MFRL

- 直接使用 GPs 学习最佳 Q 值,而非学习 env model。

- 基本假设:附近的 state-action pair 产生类似的 Q 值。

- GPs 使用 squared-exponential kernel。

- 同样,每个模拟器使用单独的 GP。

- 算法:

- 使用类似的阈值(σ_th 和 σ_th^sum)来确定何时切换到低保真或高保真模拟器。

- GPQ-MFRL 检查 agent 在前一个模拟器中是否对最佳 Q 值有足够准确的估计(第 8 行),如果没有,切换到前一个模拟器。

- 第 10 - 15 行描述了算法的主体,agent 将 transition 存入 Di(第 11 行),然后为每个 Di 中的 transition 更新目标值(第 14 行)(batch training)。GP 模型在每一步后被更新(第 16 行)。

- agent 利用在上级模拟器中收集的经验(第 25 - 27 行)来选择当前模拟器中的最佳行动(第 6 行),利用最高已知 Q 值((s,a) 的后验方差小于阈值 σ_th)的模拟器(第 27 行),来选择当前模拟器的下一个动作。

- 如果不存在这样的高保真模拟器,则使用低一层模拟器的 Q 值(第 24 行),使用保真度参数 β。

- 每当 agent 在模拟器中收集到新的样本时,GPQ-MFRL 就会进行一次 batch re-training(第 13 - 15 行),使用新样本的知识,更新以前训练数据的 y 值。

- 然后,用这些更新的 y 值,来训练 GPs 形式的 Q 值(第 16 行)。

- 更新 GP 的计算成本是数据量的三次方;然而,我们可以使用稀疏 GP 技术 [6] 对数据集进行修剪,即,只用一小部分数据来 fit GP。

- 不容易选择置信度界限的值。在目前的实验中,我们选择 σ_th^sum 为可能的最大 Q 值的 10%,σ_th 为 σ_th^sum 的 1/5。

5 experiment

- 写的蛮清楚的。

- GP-MFRL 比 14 年最初的 MFRL 效果更好(用的 high-fidelity 样本更少)。

- GP-VI-MFRL(model-based)在训练最开始时比 GPQ-MFRL(model-free)表现更好,与传统 RL 经验一致,即 model-based>model-free。

6 讨论与展望

- 未来可以将 MFRL 技术与 sim2real 方法进行比较 [1]。

- 与 sim2real 不同的是,MFRL 技术明确决定何时在模拟器之间切换,并使用两层以上的模拟器。

- 或许可以将这两个想法结合起来:使用 MFRL 来利用一些更便宜 / 更快的模拟器;使用参数化的模拟器,来引入领域适应 / 随机化(domain adaptation/randomization),以获得更好的 generalization。

- 可改进的地方:在目前的方法中,进行 GP 回归时,来自不同模拟器的数据没有结合起来。

- 1 使用多任务 GPs,它可以同时产生多个输出,分别对应于每个保真度模拟器。

- 2 使用 deep GP ,将不同保真度的数据 拿来训同一个 NN。

- 对以上两种情况,我们希望直接学习不同环境下的数值之间的相关性。