如何让ChatGPT高效的理解你的Prompt

1.概述

ChatGPT是由 OpenAI 开发的一种强大的语言模型,它在许多自然语言处理任务中展现出了惊人的能力。而其中一个关键的技术概念就是 "Prompt"。本文将深入探讨 Prompt 的概念、作用和应用,以及如何在与 ChatGPT 进行交互时充分利用 Prompt 的能力。

2.内容

ChatGPT 是一种基于深度学习的语言模型,具备出色的自然语言处理能力。然而,ChatGPT 的生成结果有时可能难以控制,因为它没有明确的指导或上下文。为了解决这个问题,研究人员和开发者引入了 Prompt 的概念,作为一种在与 ChatGPT 进行交互时使用的引导文本片段。

2.1 什么是Prompt?

Prompt 是一段用于引导 GPT 模型生成特定响应的文本。它可以是一个问题、一句话、一段对话或一些关键提示。Prompt 提供了上下文和指导,帮助模型理解用户的意图,并生成相应的回答或内容。

举个例子,对于一个语言模型,Prompt 可以是 “有一只小猫咪在${type}”,模型可以通过对接下来的词语进行预测,生成类似于 “凳子上”、”椅子上”、”沙发上” 等不同的输出。Prompt 在人工智能语言生成领域中扮演着重要的角色,因为它可以帮助模型更好地理解用户意图,并生成更准确、有意义的文本内容。 诸如于如下的 Prompt:

I am a highly intelligent question answering bot. If you ask me a question that is rooted in truth, I will give you the answer. If you ask me a question that is nonsense, trickery, or has no clear answer, I will respond with "Unknown". Q: What is human life expectancy in the United States? A: Human life expectancy in the United States is 78 years. Q: Who was president of the United States in 1955? A: Dwight D. Eisenhower was president of the United States in 1955. Q: Which party did he belong to? A: He belonged to the Republican Party. Q: What is the square root of banana? A: Unknown Q: How does a telescope work? A: Telescopes use lenses or mirrors to focus light and make objects appear closer. Q: Where were the 1992 Olympics held? A: The 1992 Olympics were held in Barcelona, Spain. Q: How many squigs are in a bonk? A: Unknown Q: Where is the Valley of Kings? A:

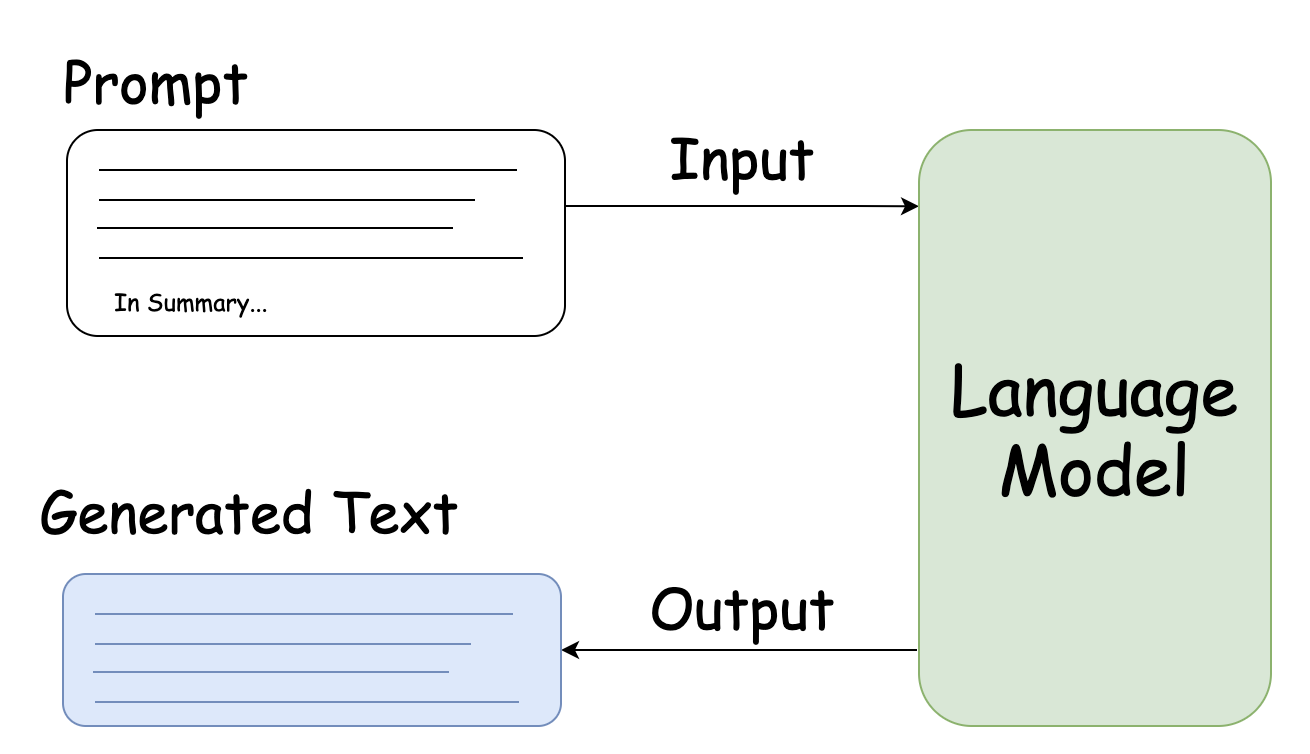

一个Prompt的交互流程图,大概如下所示:

Prompt 的工作原理基于语言模型的训练和调整。在训练过程中,模型接收包含 Prompt 的输入和对应的输出数据,从中学习生成适当的响应。在使用过程中,用户提供的 Prompt 可以包含问题描述、格式示例、特定要求等,以帮助模型更好地理解用户的需求和意图。

2.2 Prompt核心要素

1.引导Prompt优化生成结果

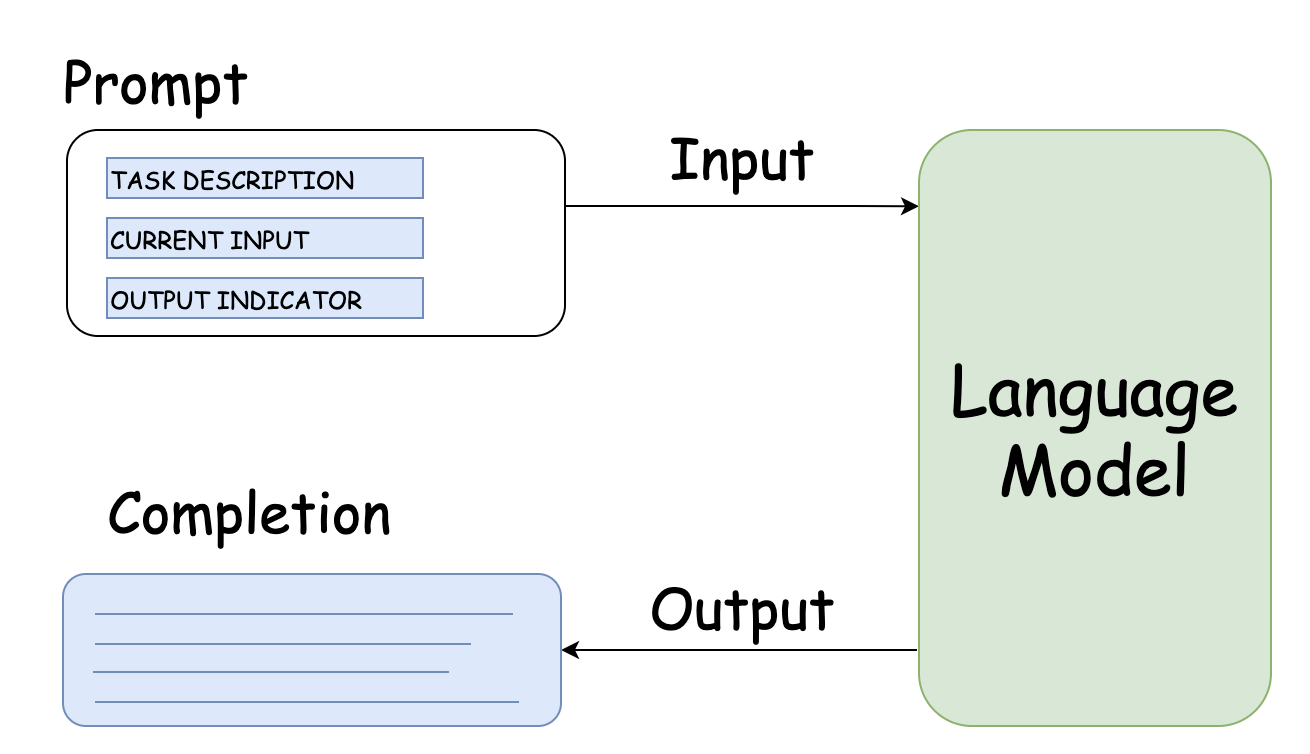

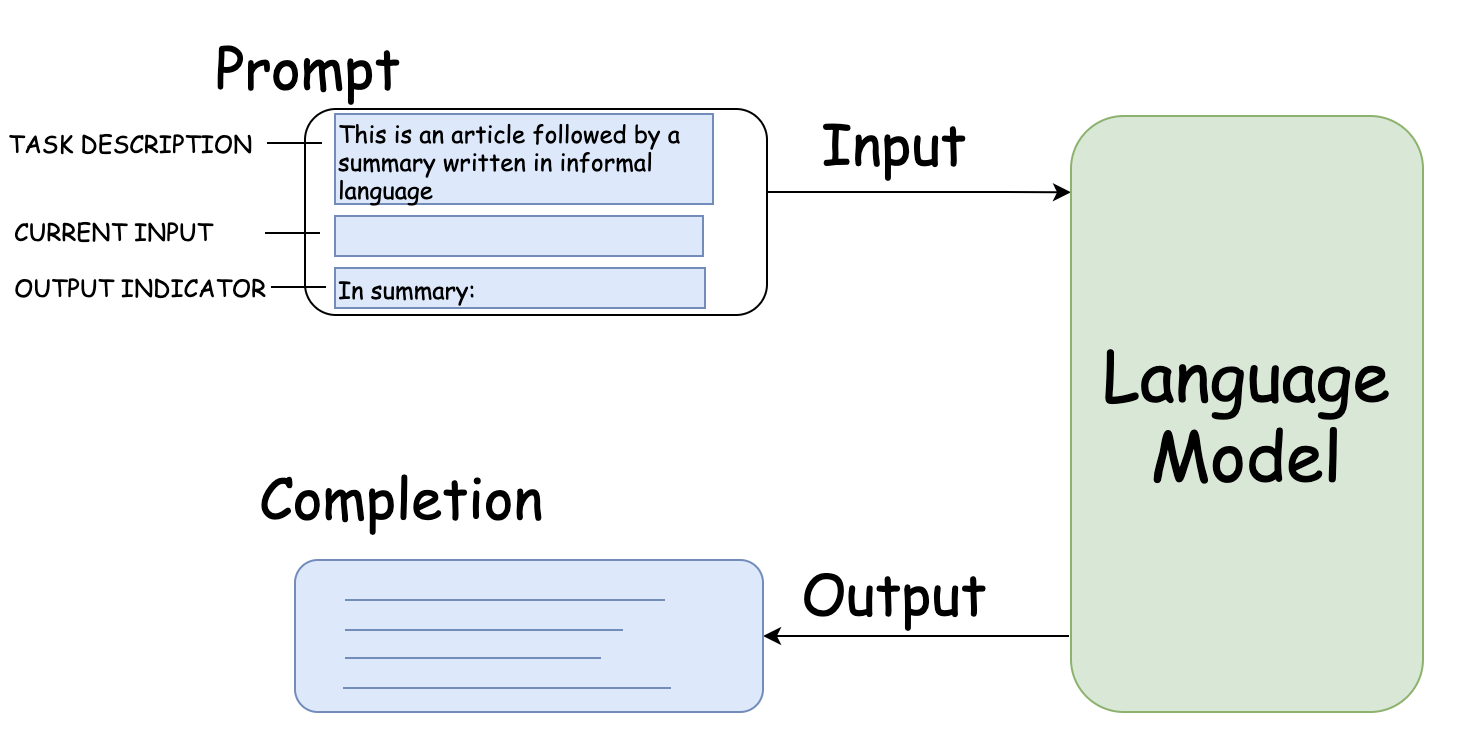

例如,如果您需要一篇文章的摘要,那么如果您按如下方式引导,那么经过足够数据训练的大型语言模型可以生成摘要:

在AI领域中,Prompt模式通常是指一种输入-输出的数据格式,用于训练和评估机器学习模型。在Prompt模式中,输入数据通常是一个问题或指令,而输出数据则是对应的模型生成的响应或结果。

Prompt模式的使用可以帮助模型更好地理解和处理特定任务。通过在输入中提供清晰的问题或指令,模型可以更准确地理解用户的意图,并生成相应的输出。这种方式可以使模型更加可控,从而满足特定的需求。

Prompt模式的设计和选择对于训练和评估模型的性能和效果至关重要。合理选择和构建输入的问题或指令,以及相应的输出数据,可以使模型得到更准确和有意义的训练。同时,评估模型时,使用合适的Prompt可以提供明确的标准来衡量模型的性能和能力。

然而,Prompt模式也面临一些挑战和限制。设计良好的Prompt需要具备足够的信息量和清晰度,以确保模型可以正确理解任务要求。此外,Prompt的选择也需要考虑到领域特定性和多样性,以满足不同情境下的需求。

比如,如下是一个完整的定义:

- 模式名称:Prompt 模式

- 问题描述:如何有效准备机器学习模型的训练数据?

- 解决方案:Prompt 模式使用简单的输入-输出数据格式。输入文本是问题或指令,输出文本是模型预测的答案或结果。这种格式减少了训练数据需求,提高了模型的泛化性能,并使输出更易于理解和解释。

- 效果:使用 Prompt 模式简化训练数据准备,提高模型效率和准确率,增加可解释性和可理解性。

- 适用性:Prompt 模式适用于自然语言处理领域的各种任务,如文本分类、情感分析、问答系统、机器翻译等。也适用于其他需要自然语言输入和输出的任务。

- 结构图:Prompt 模式结构简单,由输入文本和输出文本组成。输入文本包含关键词或短语,指定模型任务或操作,输出文本为模型预测结果。

2.探索多种Prompt形式以优化生成效果

在使用生成功能时,尝试多种不同的 Prompt,对于解决所面临的问题非常有用。相同 Prompt 的不同表述在人类看来可能相似,但生成的结果可能会有很大差异。这可能是因为我们的模型学习到不同的表述实际上在不同的语境和目的中使用。以下是我们发现在不同任务中特别有效的一些示例。

在摘要生成的例子中,如果总结起来不会产生好的生成结果,我们可以尝试使用“用通俗的语言概括”或“这篇文章的主要观点是”。

此外,还可以在 Playground 中使用可能性功能,查看模型是否难以理解特定的词语、短语或结构。但请注意,序列开头的平均可能性始终较高。模型可能会给首次引入新概念或名称的部分分配较低的可能性,但一旦模型见过一次,它就可以轻松地在生成中使用它。您还可以利用可能性功能查看是否存在拼写或标点符号导致词元化问题的情况。

比如常见的Prompt模式:

- 特定指令Prompt:提供问题或关键词,生成相关文本,适用于答案、解释或推荐等任务。

- 指令Prompt:给出明确指令,生成需要指令的文本,适用于技术说明书、操作手册等。

- 代理Prompt:充当代理,处理与特定角色或实体相关的任务或请求。

- 示例Prompt:提供示例文本,生成类似的文本,适用于自动生成电子邮件、产品描述、新闻报道等。

通常情况下,将任务描述的其他组成部分包含在内是很有用的,这些部分自然地出现在我们尝试处理的输入文本之后。为模型提供足够的上下文。例如,在文章之前,我们可以更详细地描述摘要任务。

示例:通过使用自然语言来塑造我们需要模型执行的任务,可以使用输入文本之前和之后的文本。

让我们通过一个不同的示例来考虑这个问题的几个方面。假设您希望使用我们的模型通过自动生成合理的回复来协助您的客户满意部门(注意:生成的内容不会发送给客户,这只是一种模拟)。

一个客户与您的公司联系,提出以下问题:

你好,我想要对我订购的咖啡机进行退款。这可能吗?

我们如何设计一个关于此场景的Prompt,以便为与客户互动的代理获取有用的生成结果?让我们首先告诉我们的模型一般的背景设置和提示的剩余部分将包含什么内容:

这是一个顾客和一个礼貌、乐于助人的客户服务代理之间的对话。顾客的问题是:你好,我想要对我订购的咖啡机进行退款。这可能吗?

我们已经告诉我们的模型预期会发生什么,并明确了我们的查询是客户的问题。接下来,让我们向模型展示我们想要给客户的回复的开头部分。

客户服务代理的回复:你好,感谢你联系我们。是的

请注意,我们明确指出下一句是对问题的回答,它来自客户服务代理,并且我们希望给出积极的答案。将所有这些内容组合起来,我们得到以下提示:

这是一个顾客和一个礼貌、乐于助人的客户服务代理之间的对话。顾客的问题是:你好,我想要对我订购的咖啡机进行退款。这可能吗?客户服务代理的回复:你好,感谢你联系我们。是的

将此输入多次输入到我们的 Medium 模型中,我们得到以下的补全结果:

是的,如果产品未使用和未开封,我们可以接受退货。

是的,我们很乐意为您退款。不过,我们需要您将商品退回我们的商店以获得全额退款。

是的,我们可以办理。请向我们发送一条消息,包括您的姓名、电话号码和退款原因。我们会尽快回复您。

请注意,即使这只是一个简化的例子,我们只使用了少量的客户服务交互,基线模型也能够产生合理的补全结果!通过在您希望模型处理特定问题和请求的示例上进行微调,可以进一步改进模型的性能。

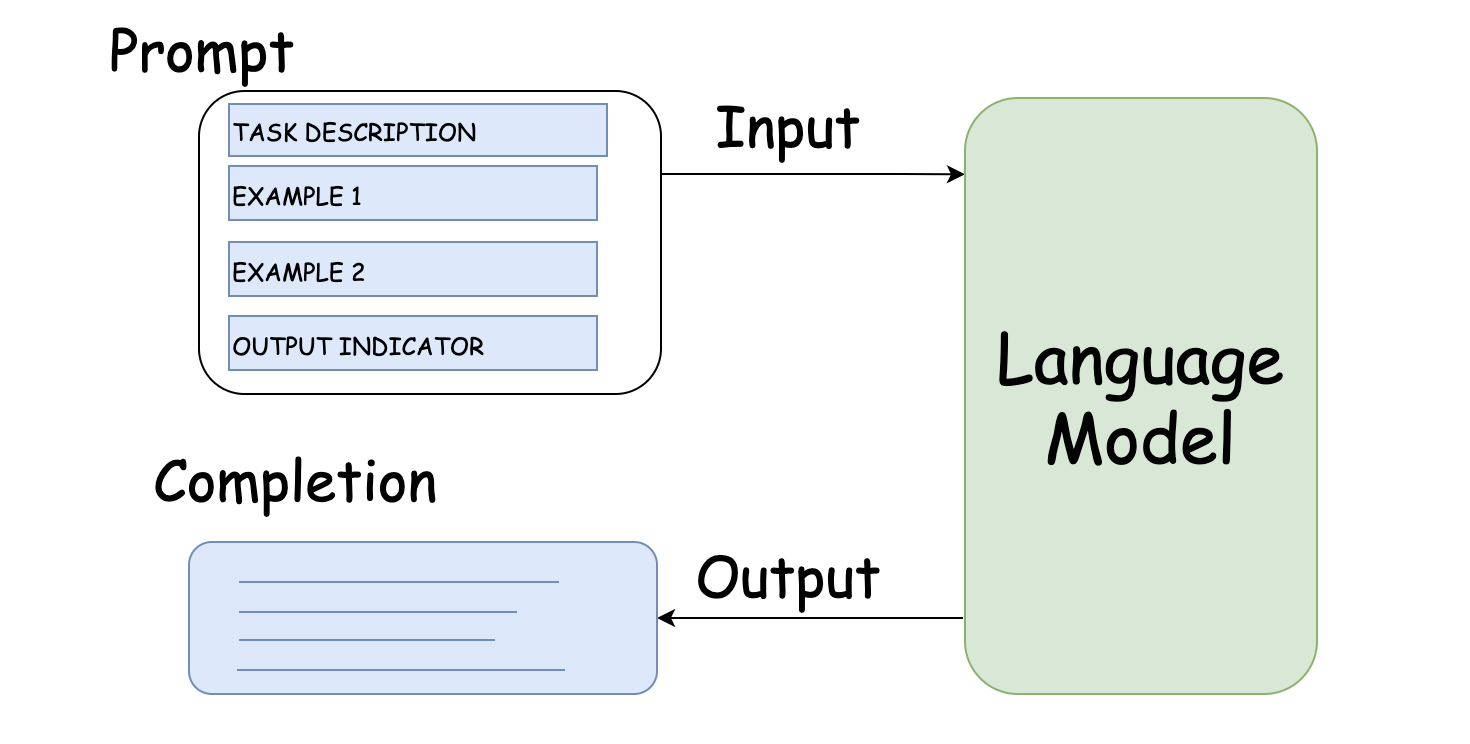

3.向模型展示期望看到的内容

向Prompt中添加示例是实现良好生成结果的关键方法之一。示例向模型展示了我们所期望的输出类型。

给出几个希望生成的类型示例。这被称为少样本学习。让我们看一个例子。假设希望使用模型对电影评论进行积极、消极或中性的分类。想象一下,将以下提示输入到模型中:

评论:"我真的很喜欢这部电影!" 这条评论的情感是

根据这个Prompt,由模型生成的实际输出如下:

考虑到电影的剧情,这条评论的情感是恰当的

将所有这些内容综合起来,将这个新的Prompt输入到模型中,我们可靠地得到了一个积极的生成结果。

这是一个电影评论情感分类器。评论:"我喜欢这部电影!" 这个评论是积极的。评论:"我不知道,还行吧.." 这个评论是中立的。评论:"浪费时间,不推荐这部电影。" 这个评论是消极的。评论:"我真的很喜欢这部电影!"

3.总结

Prompt 功能带来了许多优势。首先,它提供了对模型输出的控制能力,使用户能够引导模型生成特定类型的响应。其次,Prompt 可以提高模型的语义理解和逻辑推理能力,使生成的结果更加准确和合理。然而,Prompt 的设计和调优并非易事,需要考虑合适的指令、上下文和约束,以避免模型的误导和不准确性。

Prompt 功能可以应用于各种场景,包括但不限于以下几个方面:

- 语言翻译:通过在输入中添加 "Translate English to French: " 的 Prompt,指导模型进行英法翻译。

- 代码生成:通过在输入中添加 "Generate Python code for sorting an array: " 的 Prompt,引导模型生成相应的 Python 代码。

- 问题回答:通过在输入中添加 "Question: " 的 Prompt,引导模型回答特定问题。

- 内容创作:通过在输入中添加 "Write a short story about: " 的 Prompt,指导模型生成一个关于特定主题的故事。

邮箱:smartloli.org@gmail.com

Twitter:https://twitter.com/smartloli

QQ群(Hadoop - 交流社区1):424769183

QQ群(Kafka并不难学): 825943084

温馨提示:请大家加群的时候写上加群理由(姓名+公司/学校),方便管理员审核,谢谢!